GLM-5: Từ Lập Trình Cảm Hứng đến Kỹ Thuật Đại Diện

Giới thiệu

Chúng tôi ra mắt GLM-5 nhắm đến kỹ thuật hệ thống phức tạp và nhiệm vụ đại diện dài hạn. Việc mở rộng là một trong những cách quan trọng để nâng cao hiệu quả thông minh của Trí Tuệ Nhân Tạo Tổng Quát (AGI). So với GLM-4.5, GLM-5 mở rộng từ 355B tham số (32B hoạt động) lên 744B tham số (40B hoạt động), và tăng dữ liệu tiền huấn luyện từ 23T lên 28.5T token. GLM-5 cũng tích hợp DeepSeek Sparse Attention (DSA), giảm đáng kể chi phí triển khai trong khi bảo toàn khả năng xử lý ngữ cảnh dài.

Học Tăng Cường

Học tăng cường nhằm thu hẹp khoảng cách giữa khả năng và xuất sắc trong các mô hình tiền huấn luyện. Việc triển khai trên quy mô lớn cho LLMs gặp nhiều thách thức do sự không hiệu quả trong huấn luyện RL. Để giải quyết, chúng tôi đã phát triển slime, một hạ tầng RL không đồng bộ cải thiện đáng kể khả năng huấn luyện, cho phép các lần lặp sau huấn luyện chi tiết hơn.

Hiệu Suất và Đánh Giá

GLM-5 cải thiện đáng kể so với GLM-4.7 qua nhiều tiêu chuẩn học thuật và đạt hiệu suất hàng đầu thế giới trong nhiệm vụ suy luận, lập trình và đại diện.

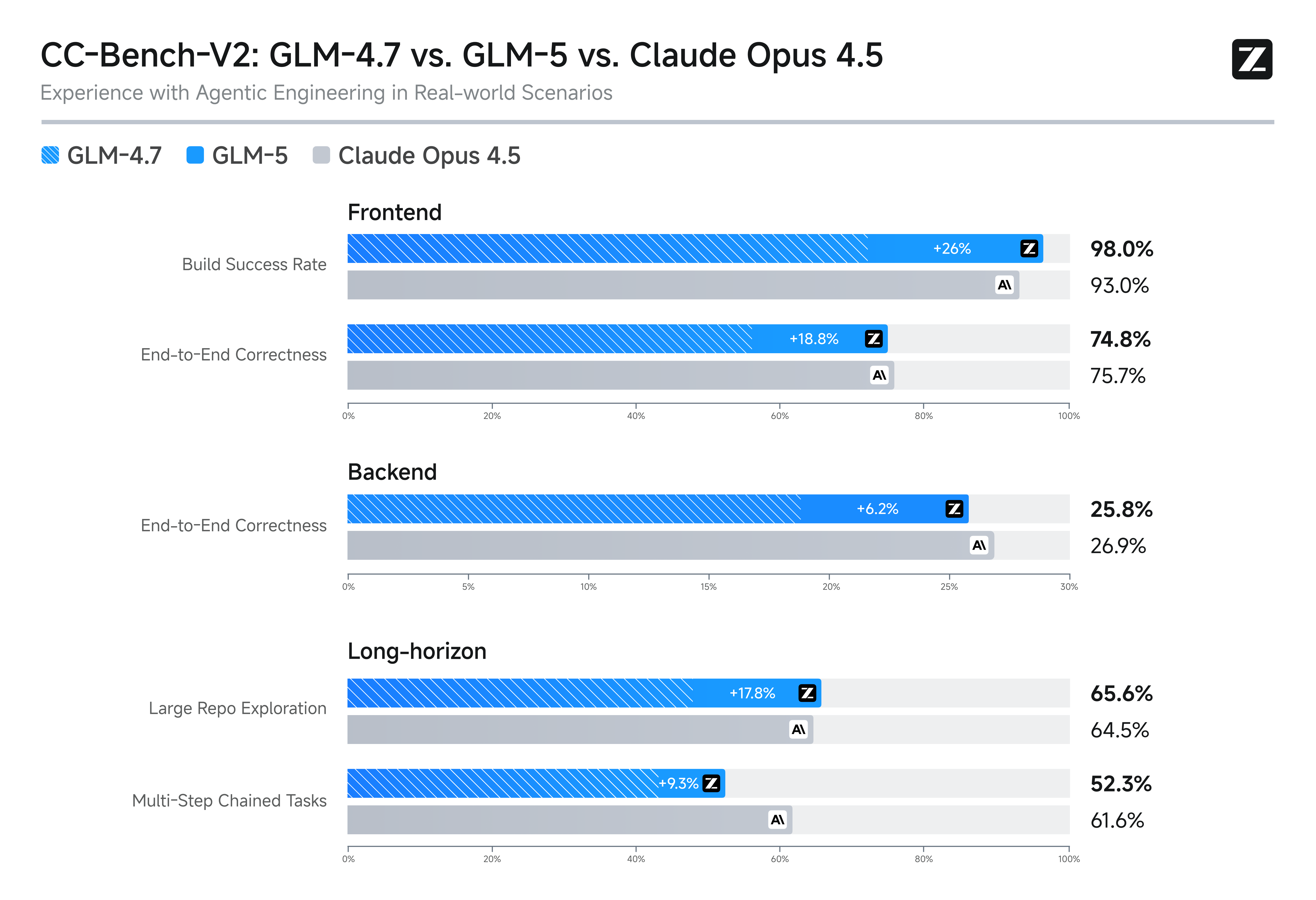

CC-Bench-V2

Trên bộ đánh giá nội bộ của chúng tôi, GLM-5 vượt trội so với GLM-4.7 ở các nhiệm vụ frontend, backend và dài hạn, thu hẹp khoảng cách với Claude Opus 4.5.

Vending Bench 2

Trên Vending Bench 2, một tiêu chuẩn đo khả năng hoạt động dài hạn, GLM-5 xếp hạng #1 trong các mô hình mã nguồn mở.

Mở Rộng Sử Dụng và Triển Khai

GLM-5 được mở mã nguồn trên Hugging Face và ModelScope, với model weights phát hành dưới giấy phép MIT.

Tích Hợp và Triển Khai

- Thử nghiệm GLM-5 trên nền tảng Z.ai.

- Đầy đủ chỉ dẫn triển khai trên GitHub.

- Hỗ trợ triển khai GLM-5 trên nhiều loại chip khác nhau thông qua tối ưu hóa kernel và định lượng mô hình.

Chế Độ và Ứng Dụng

GLM-5 có sẵn trên Z.ai, hỗ trợ chế độ Chat và Agent với công cụ đa năng tạo ra tài liệu thực tế.

Kết Luận

GLM-5 không chỉ nâng cao khả năng kỹ thuật hệ thống phức tạp và đại diện dài hạn mà còn cung cấp các giải pháp mô hình mã nguồn mở hàng đầu cho nhiều thách thức thực tế.